索尼將對所有AI産品進行倫理審查

2020/12/23

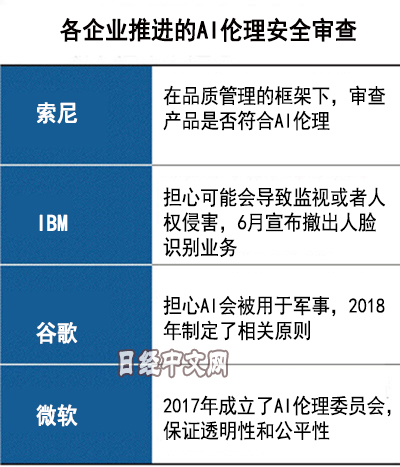

索尼最早在2021年春季對所有使用人工智慧(AI)的産品進行倫理方面的安全性審查。被判定為不合規的産品將進行整改或停止開發。AI可以提高便利性,但由於作業時的判斷標準不透明,存在可能會無意中引起歧視等問題。隨著AI産品的普及,開發人員的責任增大,企業也將強化對策。

關於AI,已經有人指出可能會造成歧視或被用於軍事領域。2019年美國蘋果新推出的評估信用卡額度的演算法被指出存在更加優待男性的問題,受此事影響,美國金融部門對發卡方高盛集團進行了調查。谷歌在2018年被曝出其AI技術可能被用於軍用無人機,發生了數千名員工向高管提交抗議連署的事件。

|

埃森哲的AI中心主任保科學世認為,如果AI進行了錯誤判斷,「有可能威脅到業務的可持續性」。

針對這一趨勢,索尼將把AI倫理指南加入以電子産品為對象的公司內部品質管理步驟中。在衡量産品安全性的指標中加入AI倫理,這在日企之中很罕見。

事業部從産品策劃到售後的各個階段,按照「隱私保護」等項目進行審查,如存在問題就進行整改。同時,還由首席執行官(CEO)指定AI倫理委員會的委員長,對指南的遵守情況進行仔細審查。即便是正在開發當中的産品,只要委員會做出判斷,就可以建議中止。已經售出的産品,如發現有重大問題,也可能成為召回對象。

|

| 索尼的機器狗「aibo」 |

索尼在2018年發售的新型機器狗「aibo」具有通過AI識別聲音和圖像等功能。將來考慮對金融和娛樂等其他業務的産品及服務也引入AI倫理審查。在AI産品不斷增加的背景下,探索把風險降至最低的方式。

美國的大型IT企業也在採取同樣的措施,谷歌從2018年起在公司內部施行AI倫理準則。規定了「避免不公平的偏見」等指導原則,觸及上述原則的開發將不會被推進。微軟也在産品的品質管理中加入AI倫理。

日本九州大學準教授成原慧指出,「學習的數據存在偏差時,AI很容易做出錯誤判斷」。另一方面,在現實中很難完整收集到公平的數據,進行倫理安全驗證的重要性越來越高。

版權聲明:日本經濟新聞社版權所有,未經授權不得轉載或部分複製,違者必究。

報道評論

HotNews

金融市場

| 日經225指數 | 56941.97 | -697.87 | 02/13 | close |

| 日經亞洲300i | 2681.80 | -15.65 | 02/13 | close |

| 美元/日元 | 152.73 | -0.27 | 02/14 | 05:50 |

| 美元/人民元 | 6.9077 | 0.0080 | 02/13 | 17:40 |

| 道瓊斯指數 | 49500.93 | 48.95 | 02/13 | close |

| 富時100 | 10446.350 | 43.910 | 02/13 | close |

| 上海綜合 | 4082.0726 | -51.9451 | 02/13 | close |

| 恒生指數 | 26567.12 | -465.42 | 02/13 | close |

| 紐約黃金 | 5022.0 | 98.3 | 02/13 | close |